Considerazioni finali

Come abbiamo detto nella presentazione dei metodi, il tema è estremamente vasto ed in continua evoluzione. In estrema sintesi proviamo ad evidenziare le differenze che intercorrono tra i quattro metodi, cercando altresì di sottolineare i vantaggi di ognuno.

Non secondaria è la tecnica utilizzata dai vari approcci:

Utilizzo di reti neurali

- DeepFakes

- Neural Textures

Utilizzo di Computer Grafica

- Face2Face

- FaceSwap

Senza dubbio più potenti in quanto più versatili sono le tecniche che sfruttano le reti neurali. Questo però presuppone la capacità di creare la rete e governarla. La maggiore qualità del metodo è dovuta al training a cui viene sottoposta la rete sfruttando gli archivi immagini (dataset) dei soggetti target. Più vasto è il dataset più lungo sarà il training ma sarà tutto a vantaggio della maggiore qualità finale. Allenare la rete prende del tempo, crescente in funzione del dataset ma anche della capacità di calcolo a disposizione. L’utilizzo di schede grafiche di alta fascia può velocizzare il processo di apprendimento ed aumentare la capacità della rete di apprendere mappature sempre più complesse.

È possibile inoltre allenare la rete con diverse tipologie di autoencoder, così da poter inserire anche orientamenti diversi dello stesso soggetto e agevolare la fase di ricostruzione da parte della rete per i soggetti in movimento (si pensi al movimento della testa e alle parti della nuca che dovessero servire).

In termini di qualità generale, tutti i metodi risentono delle stesse problematiche. Per migliorare il risultato finale si possono attuare ulteriori accorgimenti quali:

- usare video girati in condizioni di illuminazione simili;

- scegliere persone con volti simili;

- scegliere persone con tonalità della pelle simili;

- usare video e immagini che abbiano la stessa risoluzione e dimensione del viso il più possibile simile.

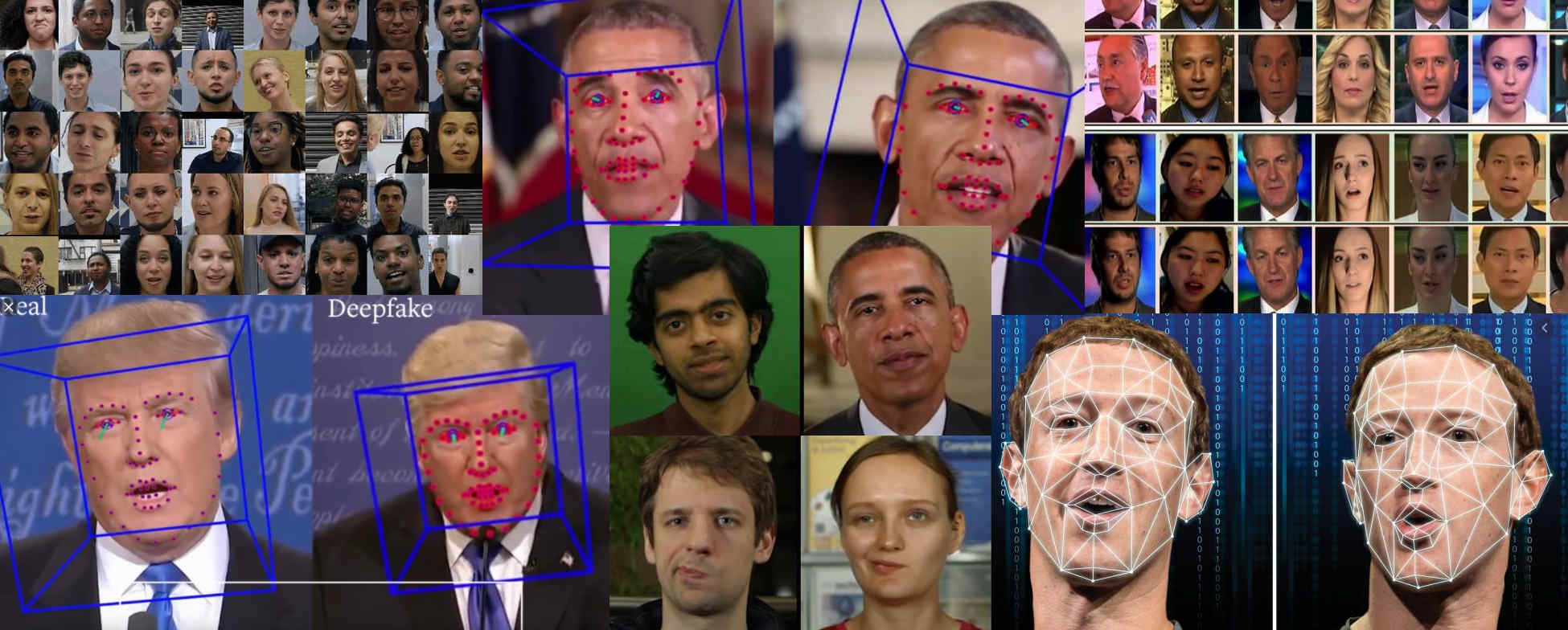

Passando alla versatilità, il metodo DeepFakes, proprio per l’uso delle reti neurali, è il metodo più versatile in quanto consente di realizzare video sia per il trasferimento delle espressioni facciali che per la sostituzione del viso.

Nella nostra analisi, l’approccio FaceSwap è stato utilizzato per la sola sostituzione del viso, il metodo è probabilmente quello più utilizzato per scopi ludici nelle App per smartphone più diffuse.

Gli approcci Face2Face e NeuralTextures vengono utilizzati per il trasferimento delle espressioni facciali. Entrambi mostrano una qualità molto alta, anche se NT sembra essere l’approccio a nostro avviso che può garantire risultati migliori. A vantaggio dello studio sull’approccio Face2Face, come sottolineato in fase di descrizione, questo è l’unico che funziona “live” con una vasta possibilità di applicazioni. Tra quelle degne di nota ci sono quelle nel campo delle traduzioni in tempo reale (sia per convegnistica che per la cinematografia) e per la partecipazione a videoconferenze per persone impossibilitate ad apparire (temporaneamente o no) alla diretta.

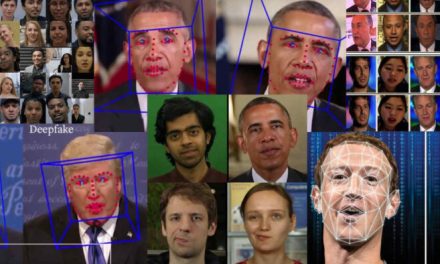

Il pericolo per l’informazione

Da tempo è iniziata la corsa per smascherare le fakenews da parte delle testate giornalistiche e dei big del web. Dalla nascita di siti specializzati contro le bufale ai metodi più avanzati per rimuovere il link dalle piattaforme social. Ma la battaglia contro i video fake creati con scopo malevolo è appena agli inizi. Dal Washington Post in poi (il primo ad organizzare un corso specifico per i propri giornalisti), tutto il mondo dell’informazione si sta organizzando. L’ANSA proprio in questi giorni ha lanciato ANSACheck[1], un sistema basato su Blockchain che consente al lettore di vedere la storia di una news e verificarne l’affidabilità risalendo alla fonte primaria. Non ultimo in questa corsa, l’iniziativa DFDC[2] – DeepFake Detection Challenge, lanciata da Facebook insieme a AWS (Amazon Web Services) e Microsoft, tra i più noti, che sembra essere abbastanza robusta per catalizzare l’attenzione di ricercatori, Università e i personaggi del web più skillati, per poter provare a vincere l’ennesima sfida tra il vero e il falso.

[1] https://www.ansa.it/sito/notizie/politica/2020/04/06/editoria-nasce-ansacheck-notizia-dorigine-certificata_4ab2b2e7-fe4a-4785-a946-92c194e99cd8.html

[2] https://deepfakedetectionchallenge.ai/